Making of imai - Fly ft. 79, 中村佳穂

この夏、3 ヶ月くらい北海道の実家に戻っていました。基本的に自動車免許を取って遊んでいただけなのですが、一方で勉強したり習作したり、わりと色々やってました。その中で最終的にできあがったのが group_inou の imai さんの MV、Fly feat. 79, 中村佳穂です。

このビデオに取りかかるまで、色々な意味で仕事や制作に関してダウナーになっていまして。なんというかとても久しぶりに、自分にとって心地いい作り方で作品と呼べるものを作ることができたような実感があって、メイキングをしっかりとドキュメンテーションしたい気持ちになれたので真面目に書いていこうと思います。同業の人向けです。

TL; DR

とはいえ、作り手的にとりあえず気になるのは「コマ撮りなのにどうしてカメラがぐりんぐりんと動いているのか」の一点かと思います。結論からいうと、カメラの位置とアングルをVive Trackerでトラッキングし、Dragonframe と連動する専用ツール上でカメラのこれまでの動きをグラフで確認しながら人力で三脚を動かし撮影しています。予めモーションパスを描いたわけでも、プレビズを作ったわけでもありません。カメラワークやおもち達の動き含め、その場で展開を考えながら撮影しています。わかる人は、諸々のコードと撮影してるところを見てください。

着想

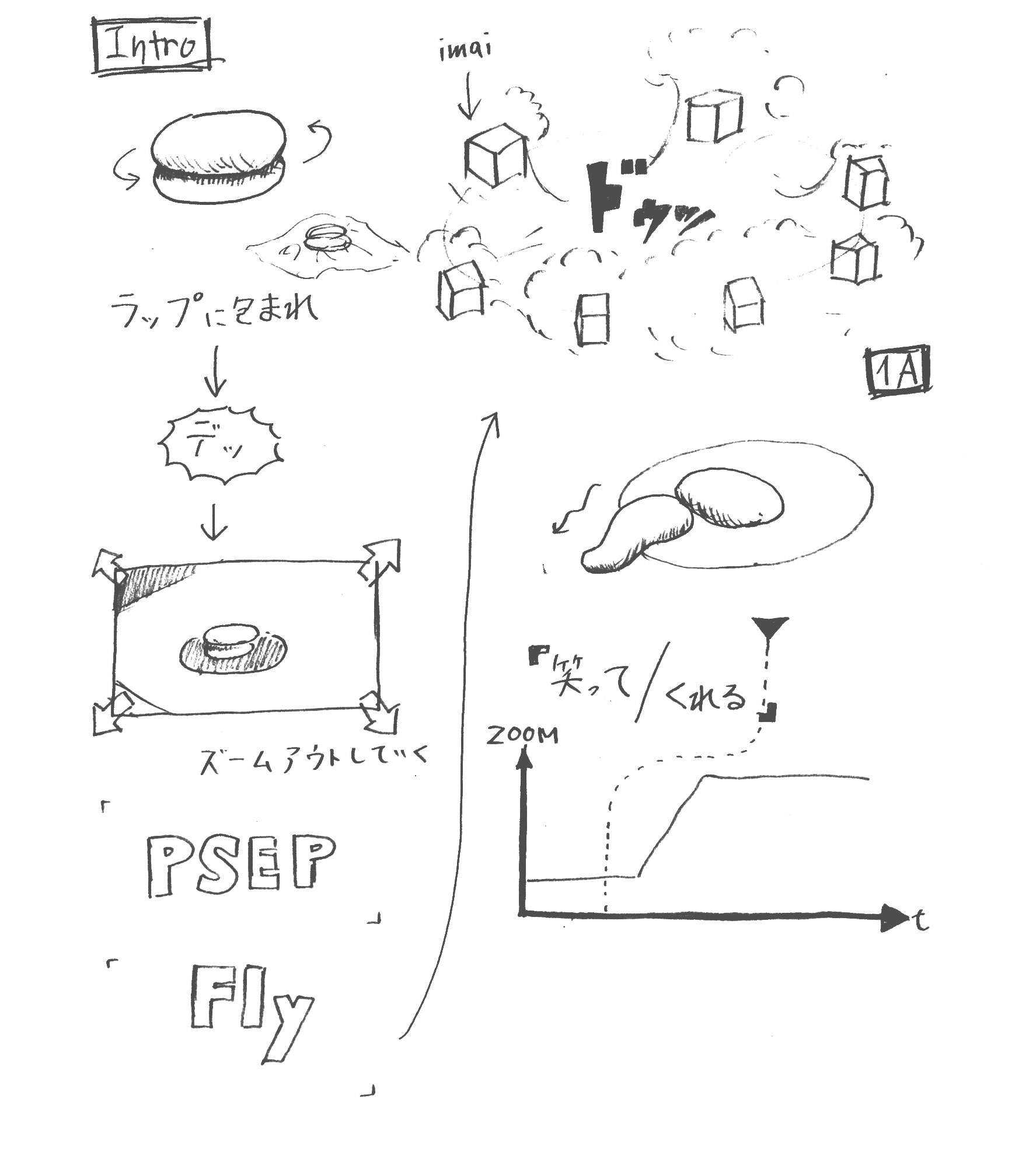

6 月の半ばに imai さんに「Fly」のデモを頂いたのが始まりです。その時はそもそも MV にするのかもホワっとしていましたが、聴き込むうちに、「🍡 をコマ撮る」「『Fly』を『Fry』と早とちる」というアイディアや空気感のイメージがその晩には降りてきたので、ひと夏の制作にすることに決めました。

餅菓子のことは、2016 年の 5 月から徐々に気になり始めていました。洋菓子と違い、食べ物というよりむしろ材質のように思えます。造形のかわいさではなく、素材がもつ柔らかさ、透明感といった物性それ自体がかわいい、というところに妙に惹かれていました。同時に、帰省した時に祖父が大量に買ってくるシルバースイーツのことも思い出しまして。無駄にカラフルなかりんとう、ネチョネチョした謎のゼリー菓子。いわゆる「和菓子」とも言えない、ただジジ臭いだけのそういう存在たちも一緒にフォーカスしてあげられたらいいなと考えているうちに、モチーフが固まりました。

夏に北海道の実家に避暑することは決めていたので、ついでならと祖父母宅でコマ撮らせてもらうことにしました。住んでいたことがあるので分かるのですが、今の時代の後期高齢者の家って、もはやステレオタイプとして語られるほど古き良きものでは無いです。至る所がちぐはぐにリフォームされているし、居間の照明だって LED。だけどキッチンだけは当時のままだったり。昭和の型板ガラスと AQUOS の混在する、生々しさ・残念さのようなものも含めて、僕にとっての「じいちゃんばあちゃんの家」のそのままを撮ることにしました。実際には両親宅も混ぜているのですが。

展開を考える

79 さんのリリックとは相反しますが、あくまで現象的には兄弟や家族といったものにおもち達を擬人化したくありませんでした。

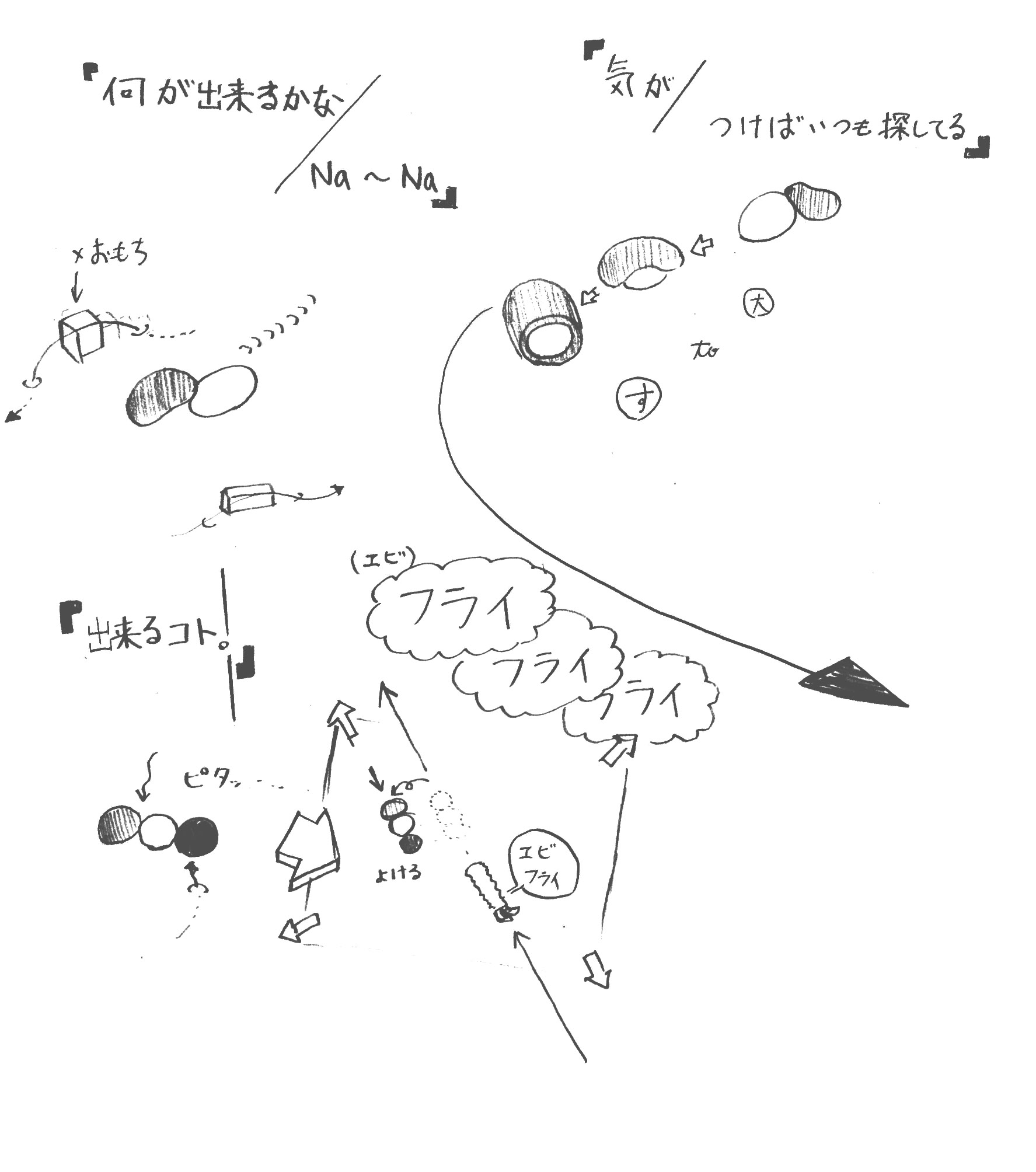

おもち達は生き物ではないけれども、原意識というか汎心論的な立場で、彼らには彼らなりの粒度の意識体験があるのだと考えることにしました。とはいえそれはかなりプリミティブなものでしかなくて、彼らは半分意思のようで、半分物理法則にただ従っているかのような動きをすることになります。三色団子 🍡 としてまとまりたがるのも、ある意味磁石 -- もしくはグルーオンのようなメカニズムで引かれ合っているだけなのかもしれません。それが、79 さんや中村佳穂ちゃんの言葉に無意味にオーバーラップして、見た人が勝手にエモーショナルな関係性を見出してしまう、そんなラインを意識しました。

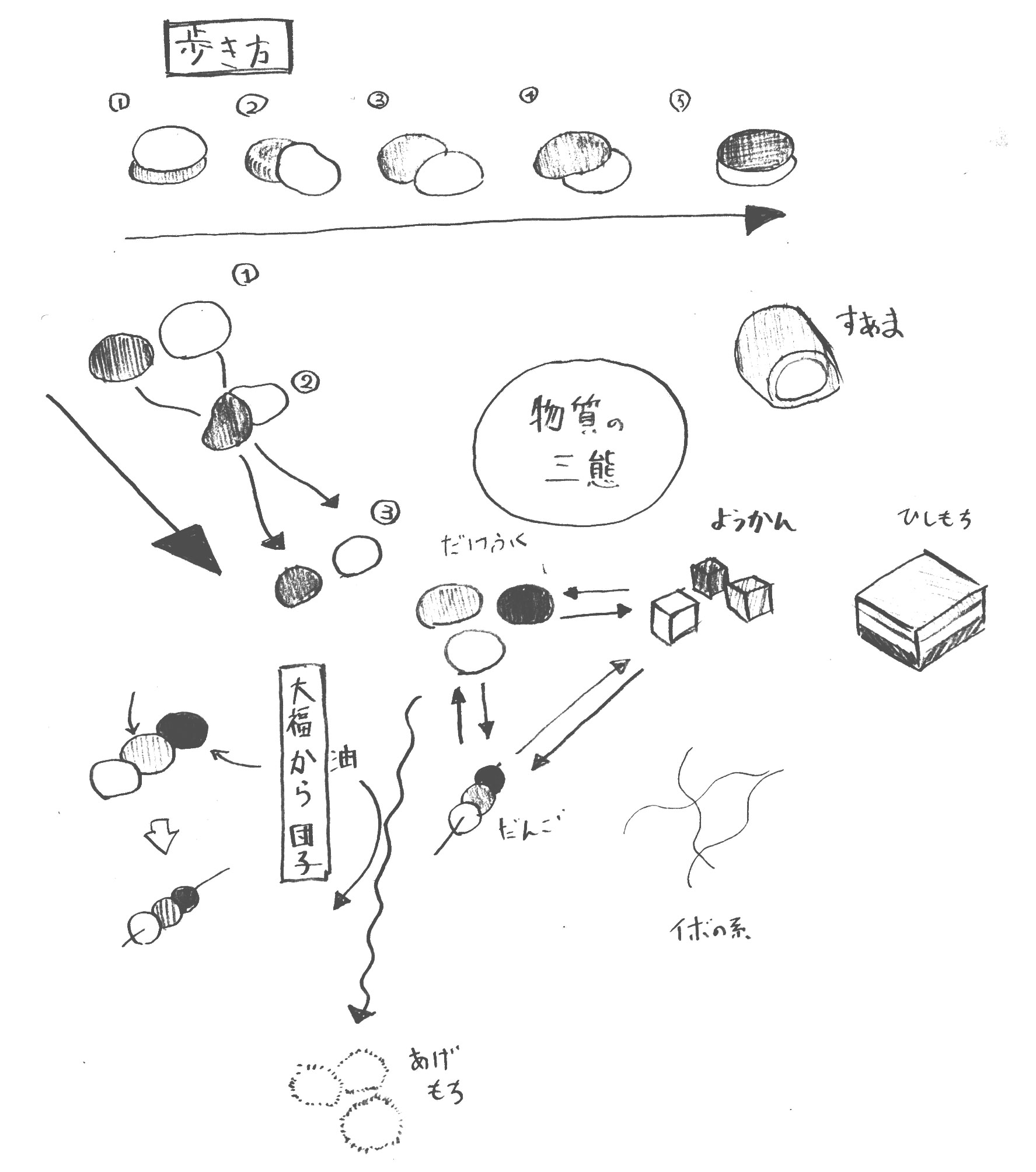

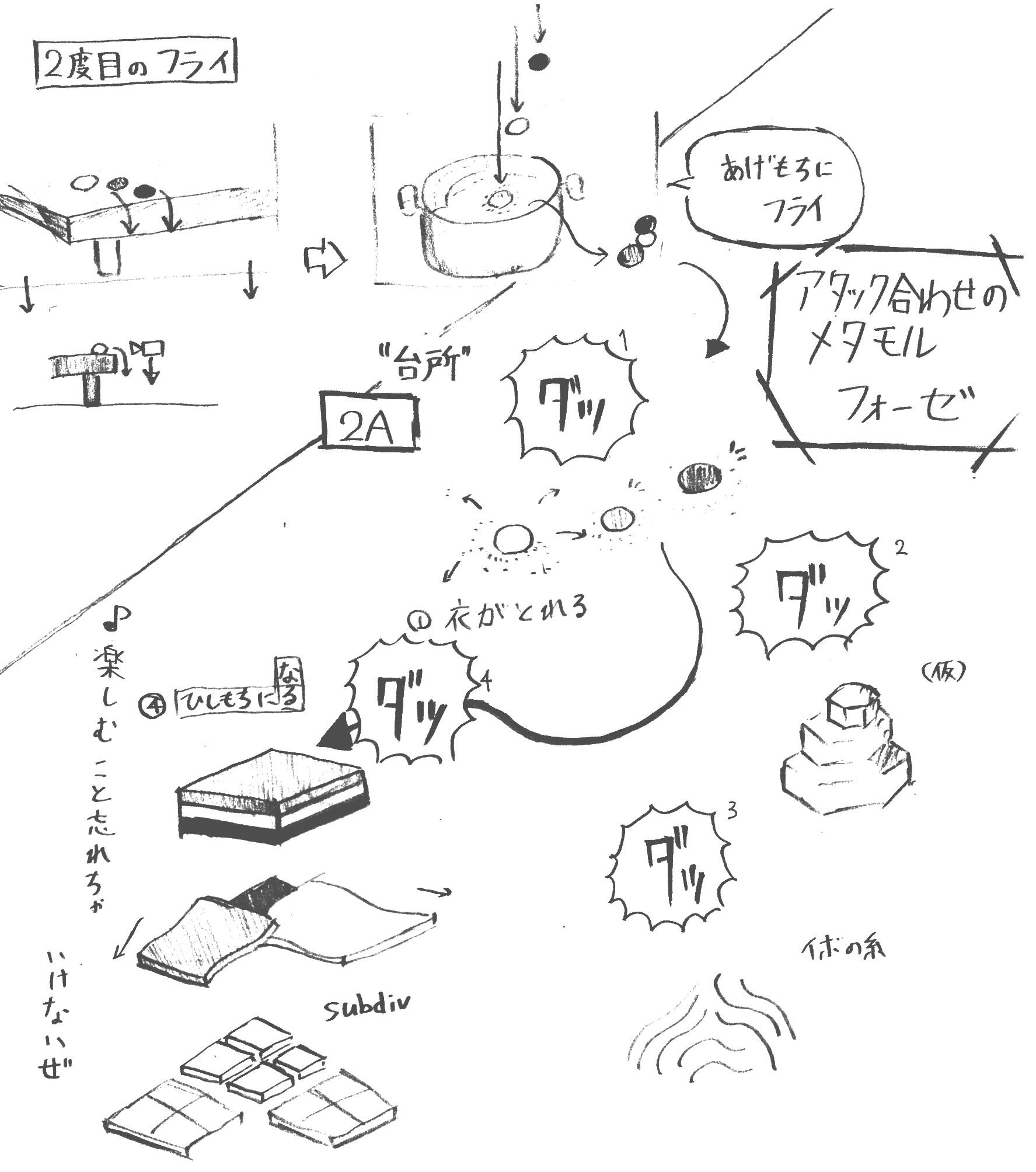

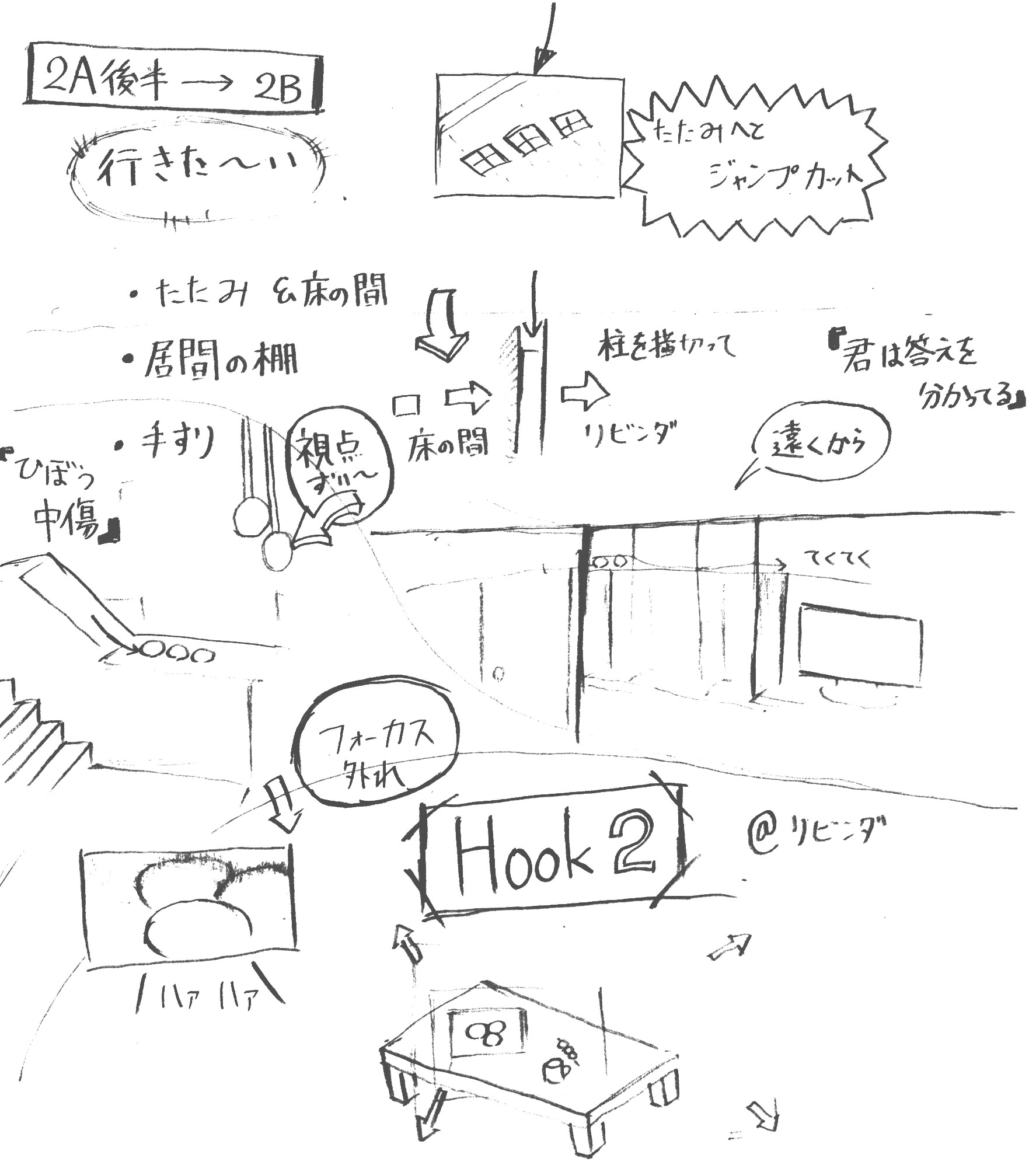

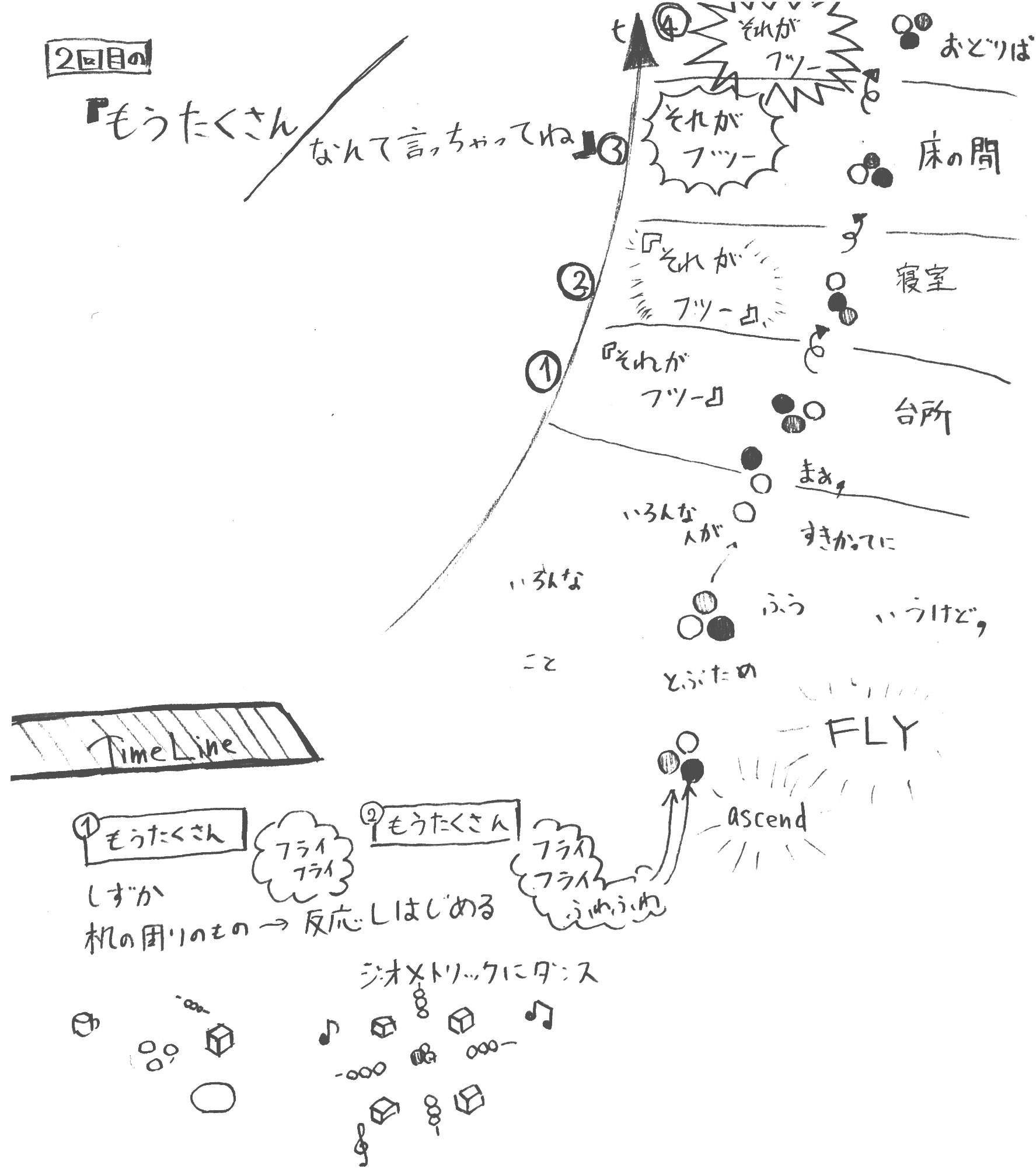

コンテの描きようが無かったので、そういう彼らなりの社会規範や状態変化の法則性、こういう風にしていると調子が良い、というような事をひたすら描いていました。結果的にコンテっぽくなりましたが。

「コマ撮り」の拡張

本業のコマ撮り職人では無いなりに、何かこの手法を発展させられたらいいなと、いくつかの試みをしました。

視点を自在に動かす

佳穂ちゃんのフックが自分的ににかなり刺さって。彼女の「どこまで」のリミックスでも感じたことなのですが、imai さんのトラックが group_inou の時とはこう、違うニュアンスを帯びて機能しているような気がしてなりませんでした。なんというか、そういう独特のバイブスを、どういう風にしたらモーションとして捉えられるかなぁ〜と考えているうちに、コマ撮りなのにカメラが手持ちのように揺れ、自在に動き回るというアイディアが浮かびました。

コマ撮りにおけるカメラワークはかなり限定的です。基本的にはパンやズーム。時々ドリーやクレーンを使ったものも見かけますが、大概モーションコントロールされているので、被写体の手作り感のある動きに対してスムーズ過ぎるように感じます。三脚を人力で動かす意欲的な作品もありますが、ちょっとカクカク気味だったり。なので、今回拘った 15 コマ/秒という比較的高いフレームレートの中である程度なめらかに、カメラをもコマ撮り的に手で動かすことを実現するために、専用の撮影システムを開発することにしました。

結果、良い副作用もありました。1 つは画面全体が動く分、画の情報量を稼げるということ。もう一つが、(主にネコによる)アクシデントでおもちがズレてもそこまでバレないということです。実際、大分気が楽になるのでこれまでほど神経衰弱せずに撮れた感覚があります。

支えをそのまま見せる

今回の制作は、数年前に作った、group_inou のアルバムのプレビュー映像のことが念頭にありました。その時はアートワークの卵を 3DCG でコマ撮り風に動かしていたのですが、本当は実写で撮りたかったな、というのがずっと気がかりで。ただ、そのとき発見できたことがいくつかあって、その一つが「支えを消さずに見せるのも悪くない」ということでした。具体的には、おもちを吊ったり斜めに固定するのに使った糸や羊羹のことです。アナログ感を醸すというよりは、急におもちが立ちあがったり宙に浮き出すと、人は「どうやって」に目が行ってしまうので、メカニズムをそれとなく示したほうが気が散らない、という話です。

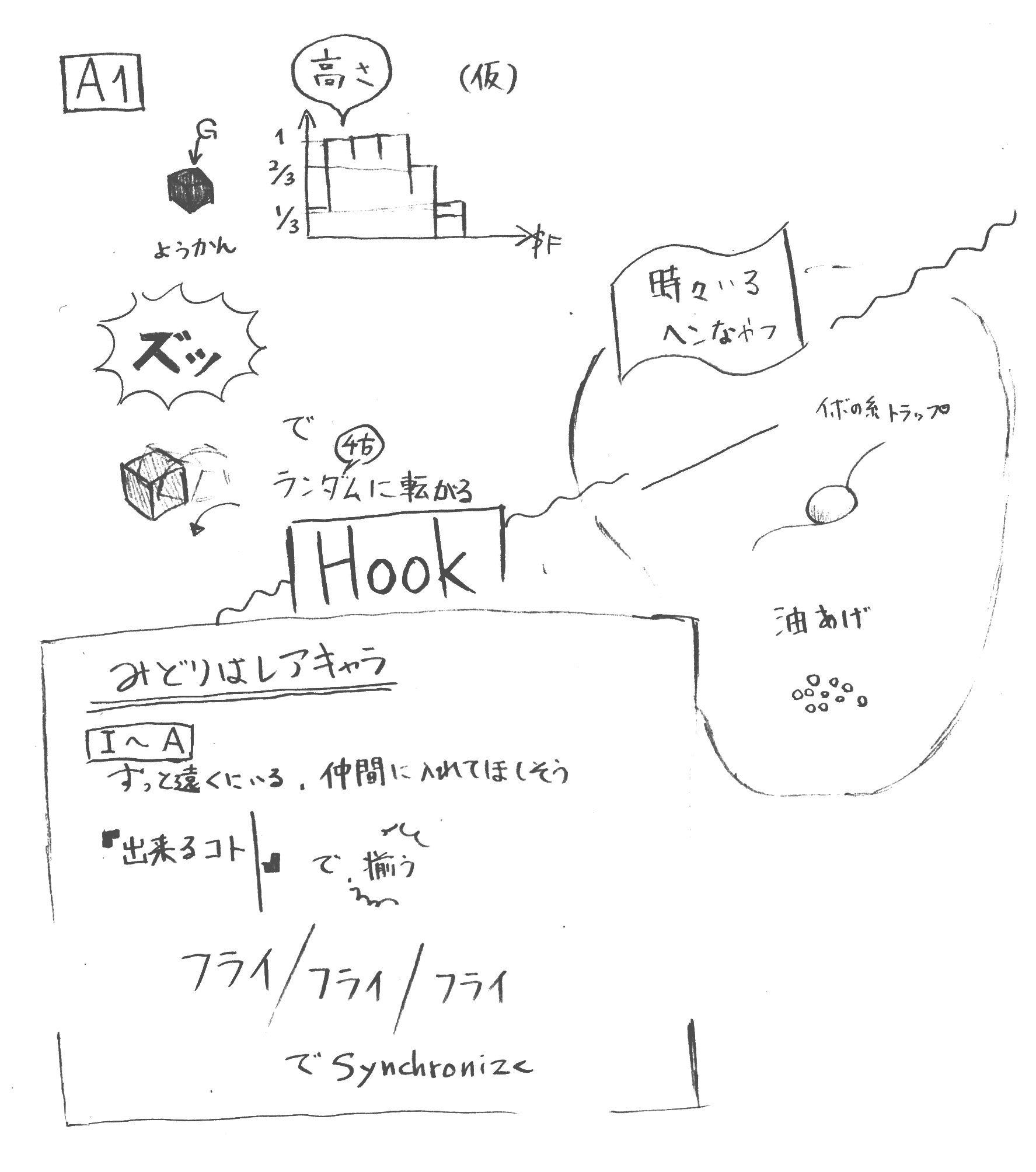

音楽とのシンクロ

前述のビデオの流れもありつつも、やはり辻川幸一郎さんのことが大好きで、四角い砂糖菓子に見て取れるように完全に「Fit Song」の影響下にあります。地面から音素に対応した物が生えてくるところは Autechre の「Plyphon」(個人制作)や、beeple の「IV.10」あたりのイメージです。ただ今回は、3DCG ではなくしゃんとコマ撮りでああいった同期をとりたいと考えていました。

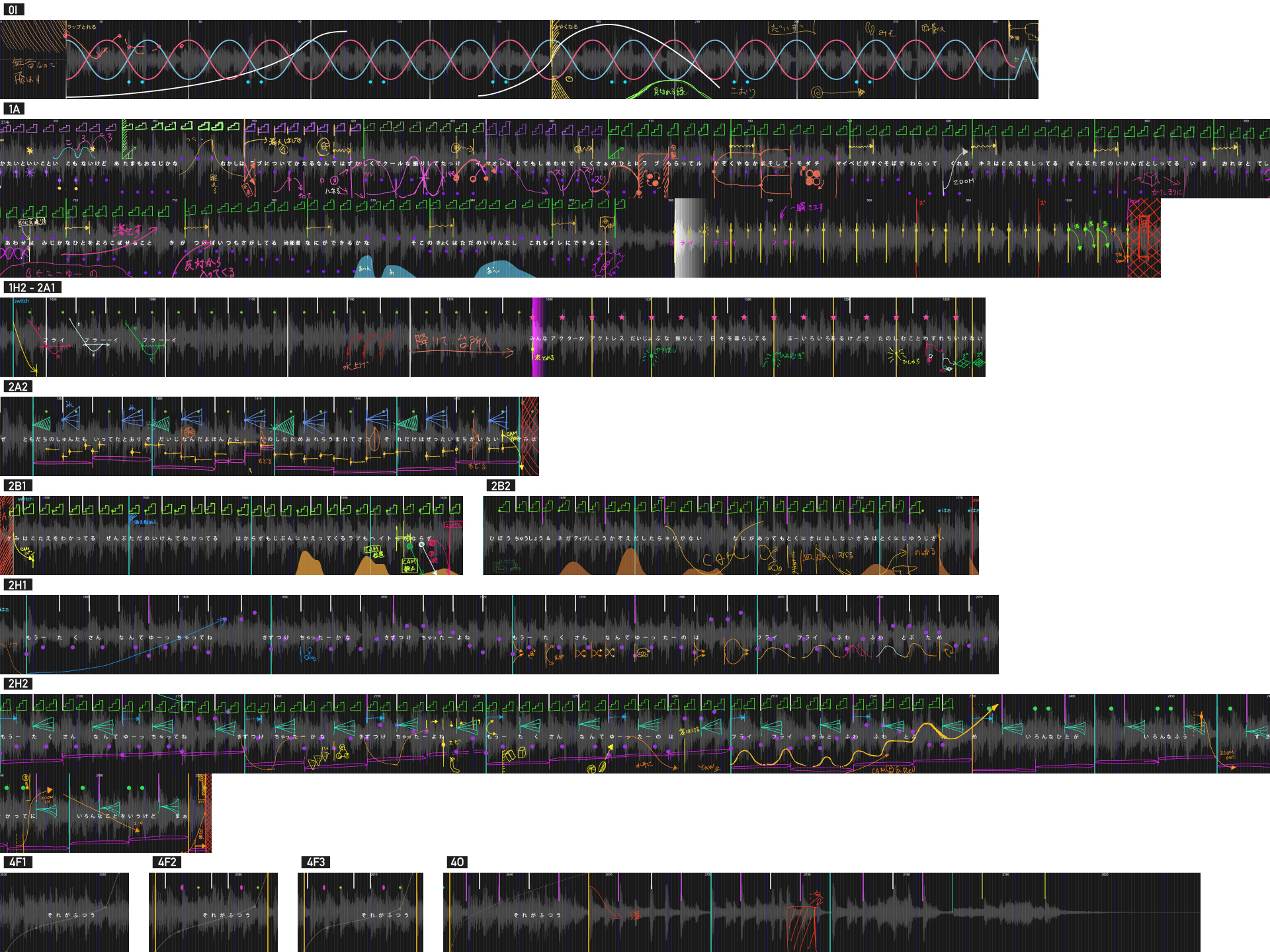

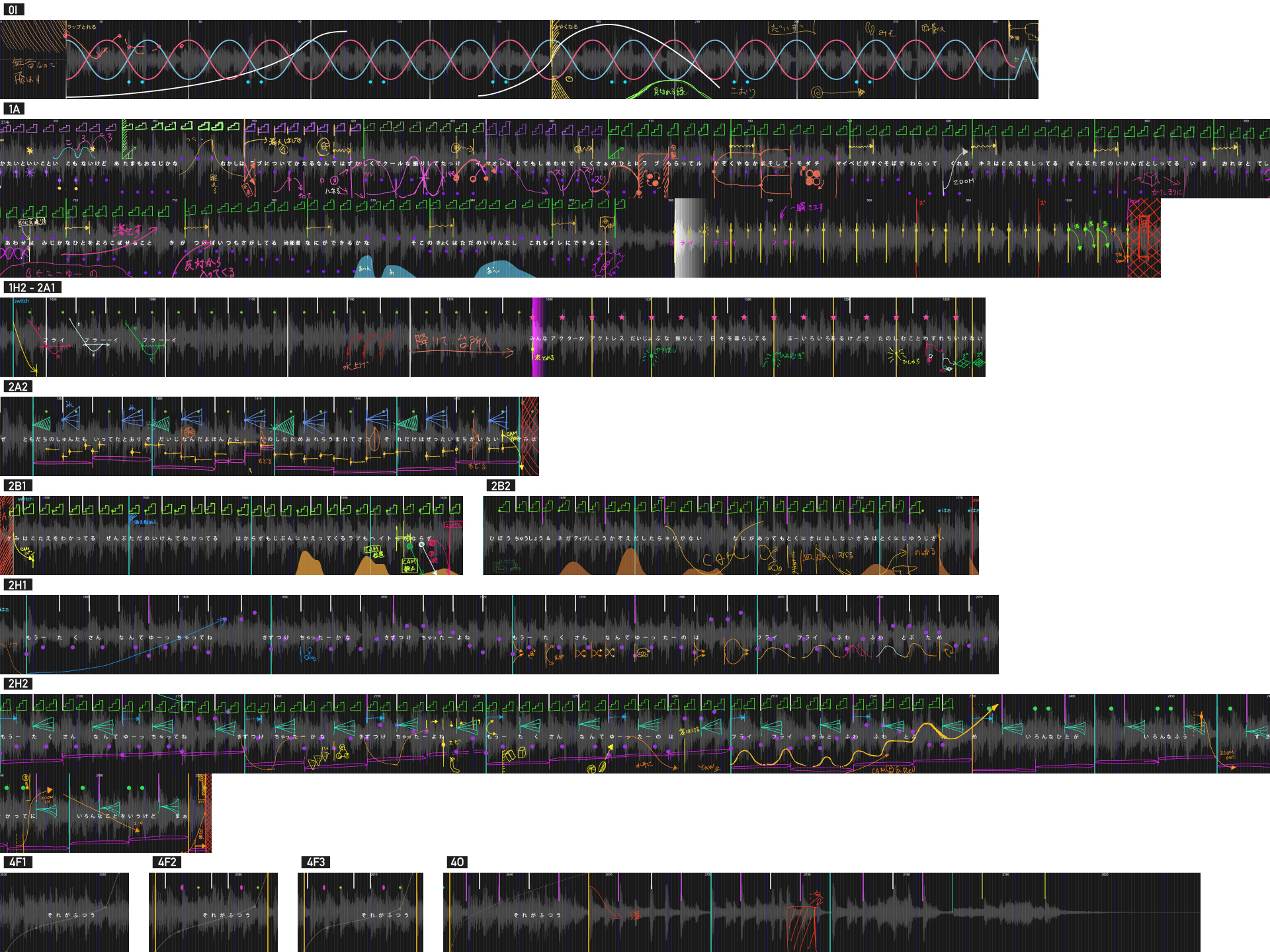

手っ取り早いのはプレビズを作ることなのですが、昨年クレイアニメでそういう作り方をした時に、撮影が「人力レンダリング」に感じられて、辛すぎて泣きました。なので、今回は波形の上に図形譜のようなものを描き込んで、タイミングのガイドにしながらその場で動きを考えるという方法をとりました。実際、おもち達の都合に振り回されるばかりで、ほとんどその通りにはならなかったのですが。

自然な手間の見せ方

コマ撮りには「あたかも実時間で滑らかに動いているように見せたい」「フィジカルな手間も誇示したい」という矛盾したモチベーションがあります。フォトリアル CG がより身近になって以降、特に後者の指向は高まっているように思えます。

Rymdreglage の「Terminator 2 - 20 years」では、溶けるロウソク等をインサートすることで時間の経過を表現しています。一方、Michel Gondry の「Dick Annegarn - Soleeli du soir」のビデオは、今度は手間がかかったということが前面に出過ぎているように感じられます。

あくまでおもち達の動きの楽しさが主題でありながら、「大変でした自慢」が必然性をもって演出に取り込まれている感じを目指したく、習作を重ねる中で、一日の光の変化や、周囲の物が生活の中で現れたり移動したりするところをそのまま見せることにしました。

撮影システムをつくる

要するに、やりたかったのはこういうことです。

- カメラの位置とアングルをトラッキング

- フレーム毎に、シャッターが押された瞬間のカメラ座標を記録していく

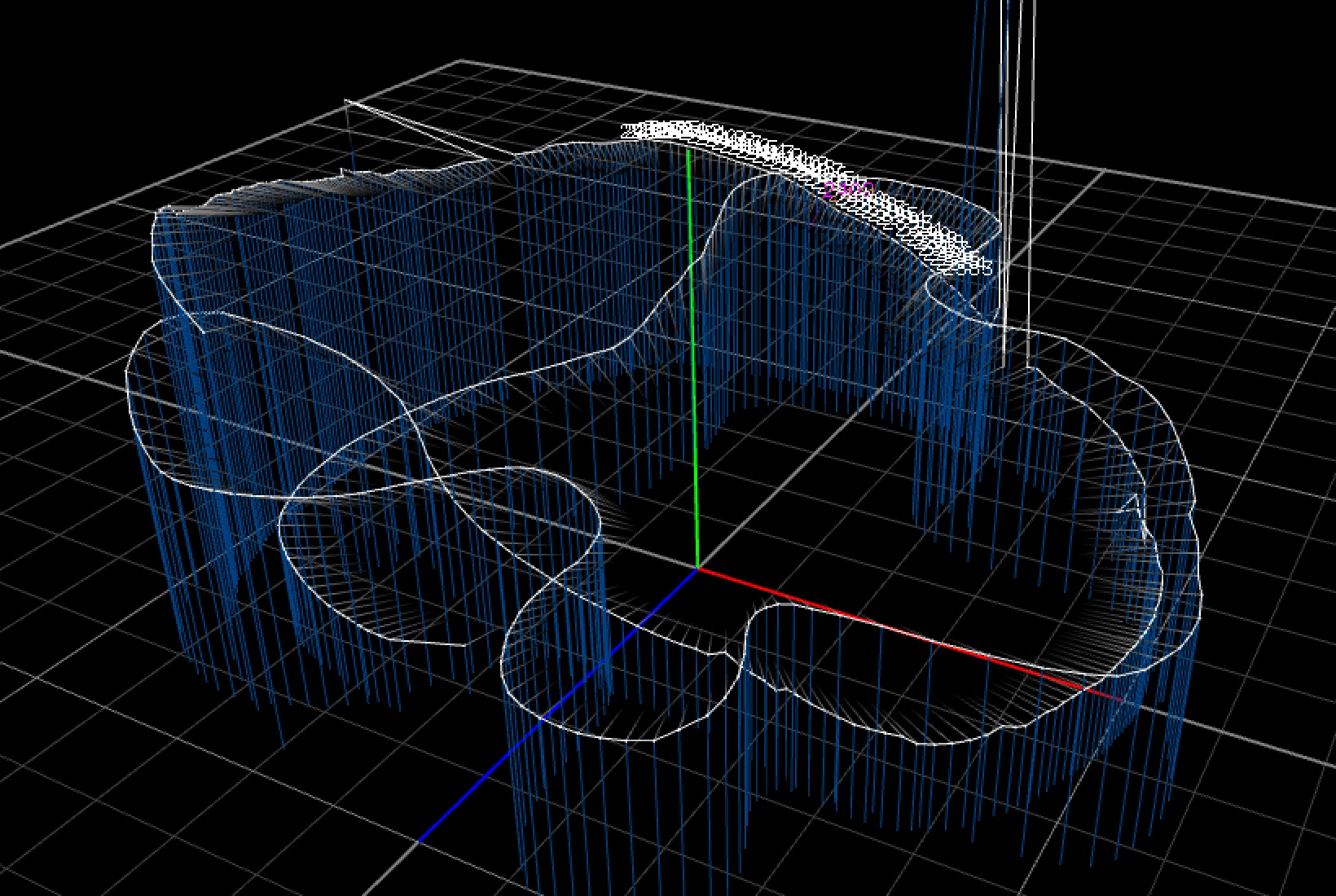

- カメラのこれまでの動きの軌跡と現在位置を 3D 空間上にリアルタイムプレビュー

- カメラワークが滑らかに変化するように、手で三脚を移動させる

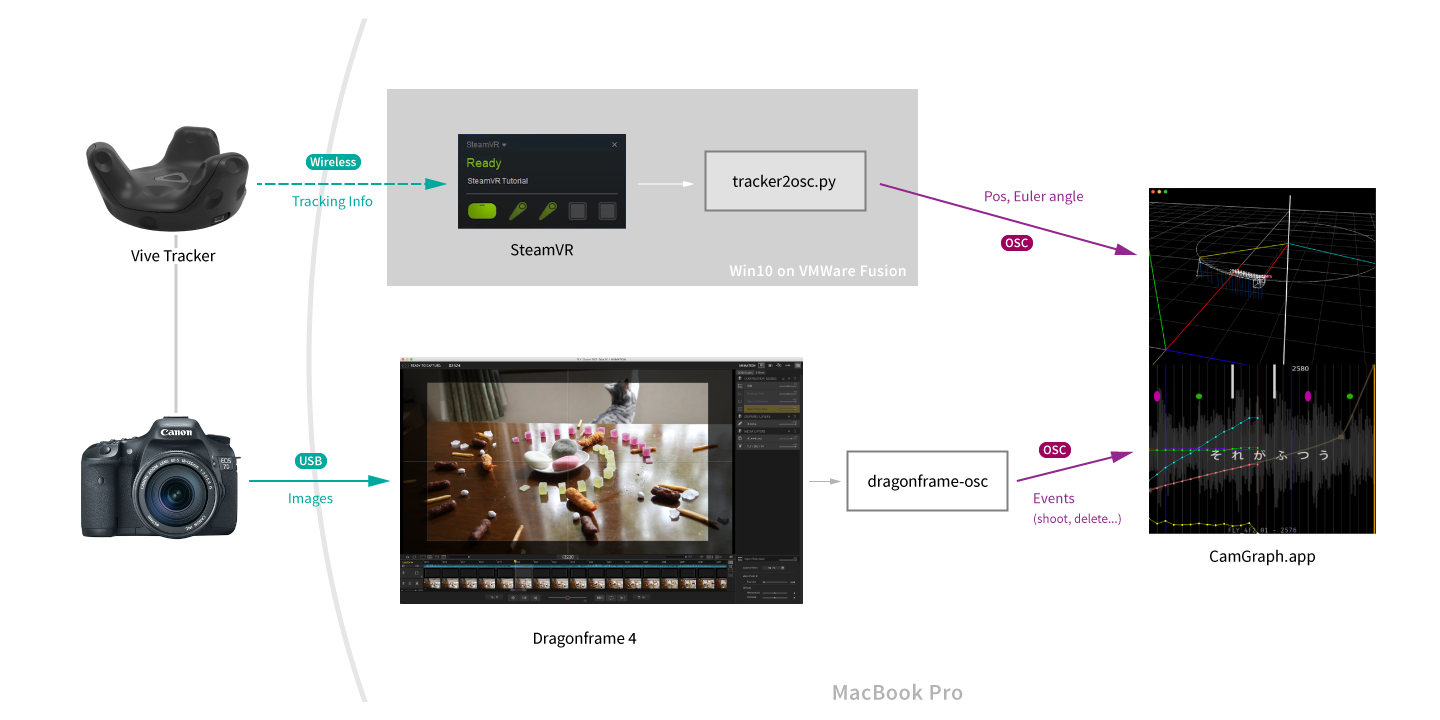

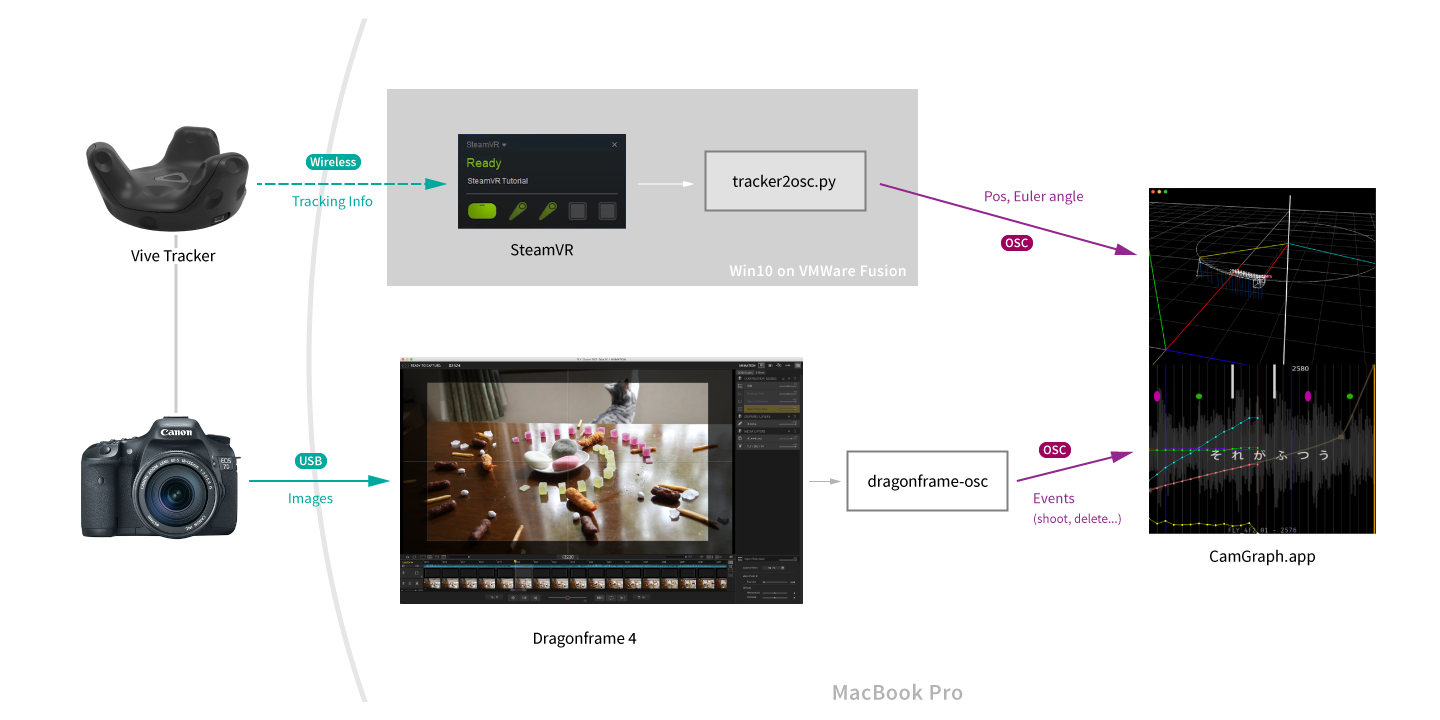

結果、こういった撮影システムになりました。

Windows で完結させればこんなややこいことにならなかった

3.のプレビュー用ツールが、図右側の「CamGraph」です。openFrameworks で開発しました。雑過ぎて僕の環境でしか動きませんが、諸々のソースです。

license type='mit' href='https://github.com/baku89/imai-flyGithub : baku89/imai-fly/license

カメラのトラッキングにはVive Trackerを使いました。これは本来 VR 用デバイスで、この記事にあるように、手やモデルガンなど好きなものに引っ付けてコントローラとして VR 空間に持ち込むといった用途に使うものですが、今回はカメラシューに取り付けて使っています。

撮影時点では対応ツールのSteamVRが macOS に対応していなかったので、VMWare Fusion 上の Windows で Tracker 周りのシステムを走らせています。Kuke Beno 氏の記事を参考に、ヘッドセット無しに単体使用するためのセットアップと、座標データを CamGraph に OSC で通知する Python コードを書きました。

コマ撮りソフトにはDragonframeを使用しました。Dragonframe 側のイベント(シャッターを切る、撮影フレームの移動・削除)をテクネの時に書いたNode.js スクリプト(dragonframe-osc)で OSC で CamGraph に通知しています。

一方 CamGraph では、OSC で受け取ったデータを元に、上部ペインにカメラ位置の軌跡、下部ペインにアングルと速度のグラフを表示させています。前述の波形と図形譜も重ねて表示させています。次の動画は実際の撮影風景です。

右側の黒いウィンドウが CamGraph

それぞれのグラフが滑らかに繋がるようにカメラを動かすという寸法です。Dragonframe に連動して図形譜もスクロールするので、タイミングの参考にしています。

習作

ツールづくりに突っ走る一方で、imai さんにすら詳細を話さずに一人だけで進めていたので、おもちがすべすべ動くことを面白いと思っているのは世の中で僕だけなのではないか、とナーバスになってきました。そこで、習作をいくつか撮ってフィードバックをもらうことに。

試しに Facebook で身内に投げたら、かわいいとかエロいとか、いい感じの反応を貰えたので少し安心しました。

撮影システムも何度かテストしながら改良しました。開発中盤、実家の居間で撮ったテスト動画です。

途中でやめるつもりが、中々楽しくなってしまってそのまま次の日の朝まで撮ってしまいました。映画「タイムマシン」のように、おもちだけ周囲とは違うスピードで時間が流れているような印象がおかしかったので、本編でも活かしています。

ひたすら撮る

2850 コマ撮影しました。1 フレーム、4-12 分。残暑 Mixとかよくかけてました。日の出から日没まで、まるっと 3 週間。

しばらく色んなスーパーに通いました。お盆や十五夜の時期と被っていたこともあり、近所のスーパーの和菓子コーナーはなかなか賑やかでした。

おもちが浮くシーンは、ホームセンターで買い集めた金具でリグを作り、計 9 本の糸で釣って撮りました。

ひたすら糸の長さを調節して動かしてたのですが、奇跡的に良いフワフワ感を出せたなぁと思っています。

大分ネコに邪魔されました。ピンポイントで芋けんぴをはたき落としにかかってきます。 写り込んでしまった家族も含めて消し込む予定でしたが、ネコはそのままにすることにしました。

これ、やってて本当にヘトヘトになるというか、お腹が空く作業なので、おもち達がカピカピになる前に食べて交代させたりしていました。(汚い話ですが)

居間でおもちが浮き始めるシーンのカメラの軌跡

ポストプロダクション

家族からの目線が辛く感じてきたので、撮影が終わってすぐに東京に逃げ帰り、編集を進めました。

「ノー CG」に拘りは無いので、節操無くレタッチしてます。はみ出たあんこを消したり、シワを整えたり。浮いてるシーンでおもちについている糸とプレートは、一度完全に消し込んだ画とブレンドさせて、「たまにうっすら見える」程度に不透明度をアニメートさせています。

タイトルは、79 さんにお願いしました。竹内泰人さんも書かれてるのですが、日常的なものでコマ撮った作品はある種の可愛らしいトーンに収束しがちです。そこに敢えて79 さんのサインペインティングをぶつけることで、「ああ、多分ああいう系の雰囲気で展開するのだろうな」と初っ端からスタンスを読ませない方向に持っていけたのではと感じています。

まとめ

これまでに触れた以外にも、リファレンスを列挙したいところなのですが、今回は真面目にサーベイしませんでした。牧野謙さんのこれなども含め、何らかの形でこういった試みは行われているはずなので、教えてほしいくらいです。ダジャレという意味では、かずおさんのビデオと偶然の一致を感じました。

あとは、「おもち、いけるな」と確信をもてた他のきっかけとしては、北海道を代表する彫刻家、安田侃の屋外彫刻美術館に行った影響もありました。

廃校の中のおもち (違うけど)

キーフレーム・アニメーション含め、僕は今まで「ポーズ・トゥ・ポーズ」の方法でしかモーションを作ったことがありませんでした。なので今回、最初から 1 コマずつ順番に画を動かしていく、いわゆる「ストレート・アヘッド(送り描き)」の方法で 1 本映像を作り切ったことに、かなり異化されたような気がします。到達地点と時間を予め決められないので、5 秒先の画も想像できません。おもち達のこれまでの動きと相談しつつ、むしろ彼らがやりたいようにやらせる位の気持ちで動かしていました。そのあたりの話も書いています。この制作を通して、そっち系の人がよく言う「アニマ」なるものの本質を少しだけ理解できたような気がしました。

Last summer, I was so tired of my client works indeed. So I decided to go back to my hometown and devote the whole summer to the music video for my friend producer, imai. I’ve made the video for ‘Eye’ from his electronic duo group_inou, which used StreetView and other creative coding techniques. Also, in this video, I introduced openFrameworks and ViveTracker to realize the smooth and free camera movement in stop motion. I would like to write the behind-the-scene down shortly.

Japanese Confectionery — Cultural Context

Some people in non-Asian countries might think, “what are these objects dancing on a table?”. The answer is this emoji:🍡. These are various types of rice cakes, which are especially popular with old people in Japan. I personally love their taste, minimalistic appearance, and softness. These have completely nothing to do with the lyrics — maybe I unconsciously wanted a kind of therapy by moving them.

The title of the track ‘Fly’ is often misheard as ‘fried’ by Japanese. Scene three rice cakes avoiding fried shrimp and then deep-fried was a kind of wordplay. In contrast, they finally flew in the air in the last scene.

Also, the entire sequence had shot at my grandparents’ house that I have nostalgic memories.

Visualizing Camera Trajectory with ViveTracker

I was wondering how to make the video look something new while using a traditional stop-motion technique. My attempt in that video was to introduce a shaking camera movement. I built a special shooting system like the one below to realize it.

I should have done with PC not to make the system such tangled.

The basic idea is:

- Keep tracking camera position and angle with ViveTracker.

- Every time a frame is captured, record a transformation of the camera at the moment.

- Visualize a camera trajectory in 3D space using openFrameworks. (CamGraph.app)

- By looking at the visualization, move the tripod by hand.

Me shooting the video with the system

Although it’s hard to explain even to people in the video industry, it’s NOT a motion control system. I’ve felt most of cameras works using some sliders or rigs are too smooth compared to the animation by hand. The key point of this system is that it doesn’t move a camera automatically but displays ‘how the camera has moved. Looking at the information, an animator has to move the tripod by themselves in the same method as other objects in a frame.

This system worked successfully beyond my expectations. I think the smooth but bit wiggled camera shaking really matched the groove of the track. I open-sourced the very tangled codes just in case.

license type='mit' href='https://github.com/baku89/imai-flyGithub : baku89/imai-fly/license

For more information:

- Dragonframe 4 — the most popular stop-motion software in the world

- SteamVR Tracking without an HMD by Luke Beno

Syncing with Music

I’m basically a motion designer fighting with fucking AfterEffects every day, but not a good stop-motion animator. So I somehow tried to integrate my way of thinking about motion with this physical technique. I never wanted to make a pre-vis on my computer because it forces me to behave as if ‘human-powered renderer’ in the real world. I tried the approach in this video with Hu Yu and Laurent Gray two years ago. However, it was so painful, and we were about to fall into depression, haha

In this project, I just drew a kind of graphic notation on my iPad Pro. Then I used it only as a hint for timings of motion so that I could leave enough space to decide how to move them, just like the straight-ahead method.

Some professionals use X-sheet feature on Dragonframe to do this, but I’m used to a horizontal timeline, so displayed it on my custom app.

In this several years, one of my theme as a video director is how I can extend the video production technique, like a lot of visual artists such as Tony Hill, Rybczynski, and Michel Gondry has done.

The point is that they merely show their unique and up-to-date processes inside their videos. Even if we know nothing about the behind-the-scenes, their videos still feel something new, yet emotional.

When I look at the recent art & tech scene, I occasionally feel there are so many projects that ended up with just a demo of cutting-edge technology. Such a video tends to begin with sequences such as calibrating projectors’ grids, and someone wiring lots of stepper motors with distracting technical descriptions.

In this project, I also wanted to show my attitude toward video production — designing a new workflow to create something new with whatever I can use, but no need to show its process inside the video. I hope everyone just enjoys the 🍡s’ dance along with imai’s emotional track, and only some geeks like you would understand what made the video feel something new technically.

I don't know whether it worked, though; I would be glad if someone felt empathy for my stance.